微博推出低成本 AI 模型 VibeThinker-1.5B,性能超越大型模型

快速阅读: 微博推出15亿参数开源AI模型VibeThinker-1.5B,成本仅7800美元,性能超越大型模型,采用“谱-信号原则”训练框架,展示小模型高效推理能力。

近日,中国社交媒体公司微博的人工智能部门推出了开源的 VibeThinker-1.5B,这是一款拥有15亿参数的大型语言模型(LLM)。该模型基于阿里巴巴的 Qwen2.5-Math-1.5B 进行了精细调整,现已在 Hugging Face、GitHub 和 ModelScope 上免费提供给研究人员和企业开发者使用,甚至可用于商业目的,遵循 MIT 许可证。

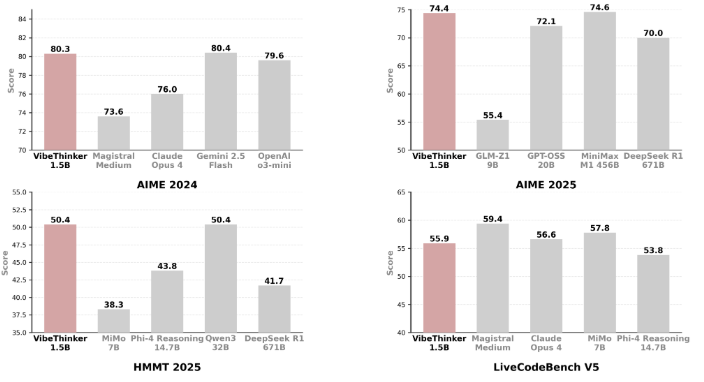

尽管 VibeThinker-1.5B 体积较小,但在数学和代码任务上表现出色,达到了行业领先的推理性能,甚至超越了拥有6710亿参数的竞争对手 DeepSeek 的 R1 模型。此外,该模型还能与 Mistral AI 的 Magistral Medium、Anthropic 的 Claude Opus4 和 OpenAI 的 gpt-oss-20B Medium 等多个大型模型抗衡,同时所需的基础设施和投资成本却少得多。

值得注意的是,VibeThinker-1.5B 在后期训练中仅花费了7800美元的计算资源,这一成本远低于同类或更大规模模型所需的数十万甚至数百万美元。LLM 的训练分为两个阶段:首先是预训练,模型通过大量文本数据学习语言结构和一般知识;随后的后期训练则使用更小的高质量数据集,使模型能够更好地理解如何提供帮助、进行推理和与人类期望对齐。

VibeThinker-1.5B 采用了名为“谱 – 信号原则”(Spectrum-to-Signal Principle, SSP)的训练框架,该框架将监督微调和强化学习分为两个阶段。第一个阶段注重多样性,第二个阶段则通过强化学习优化最优路径,使小模型也能有效探索推理空间,从而实现信号放大。

在多个领域的性能测试中,VibeThinker-1.5B 的表现超过了众多大型开源和商业模型。其开放源代码的发布,打破了对模型参数规模和计算强度的传统看法,展示了小型模型在特定任务中也能取得优异表现的可能性。

huggingface: https://huggingface.co/WeiboAI/VibeThinker-1.5B

要点:

– VibeThinker-1.5B 是微博推出的一款15亿参数的开源 AI 模型,表现出色,甚至超越了大型模型。

– 该模型后期训练成本仅为7800美元,远低于同类模型数十万的费用。

– 采用“谱 – 信号原则”训练框架,使小模型能够高效推理,提升了小型模型的竞争力。

(以上内容均由Ai生成)