100美元4小时打造聊天机器人,AI开源项目nanochat降低技术门槛

快速阅读: nanochat项目大幅降低AI模型训练门槛,普通开发者和AI爱好者仅需百元成本即可构建功能完备的聊天AI系统,涵盖从数据处理到部署上线的全流程,助力AI教育与普及。

AI模型训练的门槛正在大幅降低。一个名为nanochat的全新项目横空出世,使得普通开发者和AI爱好者能够以极低的成本构建功能完备的聊天AI系统。这个被誉为百元内最佳ChatGPT实现的项目,通过简洁的代码栈实现了一键式从数据处理到部署上线的流程,极大地降低了技术门槛。

nanochat不仅是一个模型,更是一个完整的教学工具,帮助用户深入了解大型语言模型的整个训练过程。这一从零开始的开源实现专为教育和实验设计,与以往仅关注预训练的工具不同,nanochat构建了覆盖模型训练、微调、评估及交互部署等环节的端到端聊天模型管道。

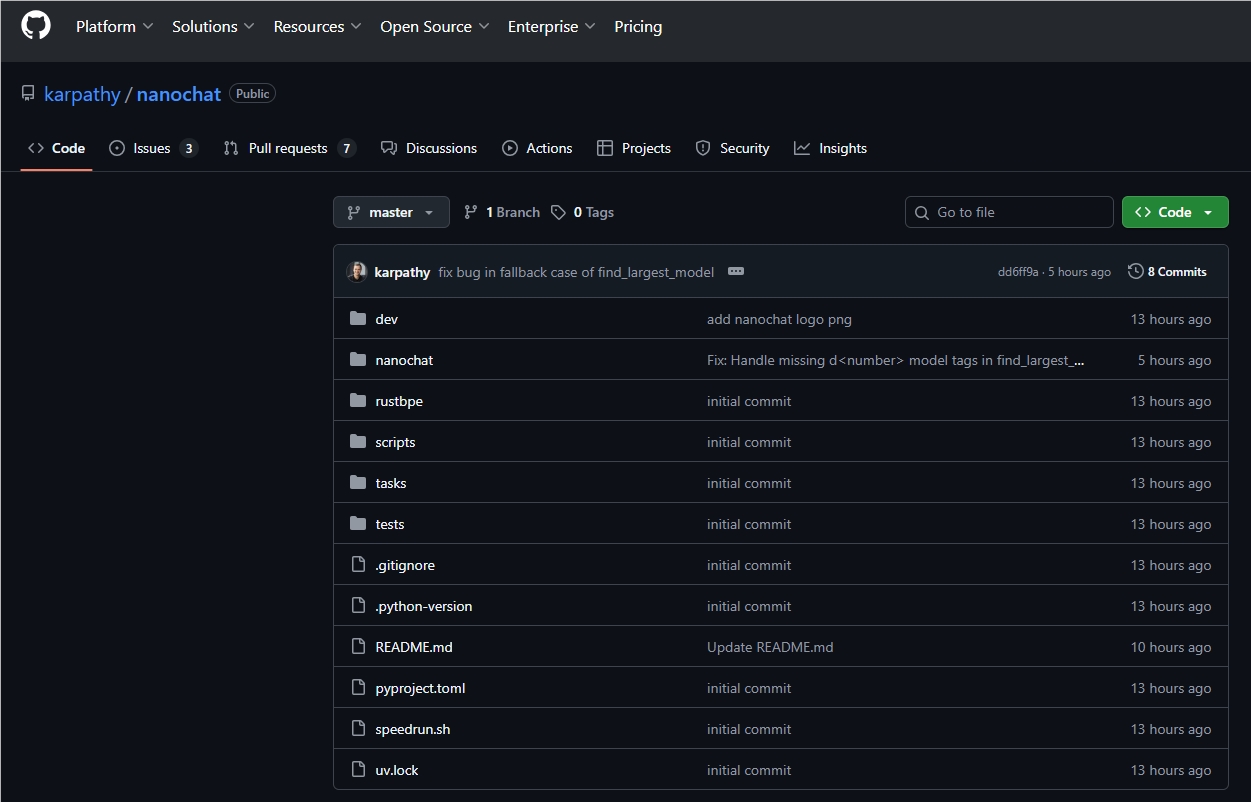

项目地址:https://github.com/karpathy/nanochat。整个系统仅需约8000行代码,依赖最少,便于阅读和修改。用户只需启动一台配备8块H100 GPU的云节点,每小时费用约为24美元,运行单一脚本smoothrun.sh,即可在大约4小时内完成所有流程。

具体流程包括:从FineWeb-Edu等高质量语料库中提取并洗牌训练数据,支持分布式高效加载;分词训练采用Rust编写的快速tokenizer,支持65536个词汇量,并预留聊天专用标记;预训练阶段使用PyTorch在GPU上训练Transformer模型,评估核心指标如损失函数和速度;中间训练与微调环节融入SmolTalk对话数据集、多选题和工具使用示例,进行监督微调,可选强化学习优化数学任务;性能评估测试世界知识、数学和代码生成等基准,输出Markdown报告卡便于量化比较。

最终,用户将获得一个支持命令行或Web界面交互的小型ChatGPT克隆,能够生成故事、回答简单问题,甚至处理基本工具调用如Python解释器沙箱。

nanochat的最大亮点在于其平民化设计。以100美元预算进行4小时训练,即可打造一个基础聊天模型,尽管有时会产生娱乐性输出,但已能进行简单对话。若扩展至12小时训练,则能超越GPT-2的核心指标。进一步投资至1000美元,约41.6小时,模型的连贯性将显著提高,能够解决初级数学和代码问题,在MMLU上达到40%准确率、ARC-Easy达70%、GSM8K达20%。

例如,一个深度30的模型经过24小时训练,计算量仅为GPT-3 Small的千分之一,却能在多选测试中表现出色。这不仅证明了高效训练的可行性,也为资源有限的开发者提供了基准参考。

作为LLM101n课程的巅峰项目,nanochat旨在提供一个统一、极简、易读且可修改的强基线栈。它鼓励社区分叉和优化,被视为潜在的研究平台或基准套件。相比于黑箱API,nanochat强调开源控制,使学习者能够从数据到推理的全链路入手,真正掌握ChatGPT的核心技术。

目前,该项目已在GitHub上开源,社区反响热烈。随着优化迭代,nanochat有望成为AI教育领域的标杆,推动更多人参与模型构建。在AI民主化的浪潮中,nanochat如同一把手术刀,精准地揭开了大型语言模型的神秘面纱。它证明了伟大模型并非遥不可及,而是可以通过几行代码和几小时计算实现的产品。这个项目不仅降低了AI学习的门槛,更为开发者提供了一个透明、可控、易于理解的完整训练流程,让更多人有机会深入理解和掌握AI技术的核心原理。

(以上内容均由Ai生成)