AI图像生成面临可信度挑战,水印技术成关键

快速阅读: 加拿大女王大学研究水印技术,以解决生成式人工智能(GenAI)图像创作中的知识产权和真实性问题。水印技术通过嵌入加密信息,确保图像来源和完整性,包括嵌入、验证、攻击防护和检测等多个环节。该技术正受到全球关注,多国政府和企业已开始实施相关措施。

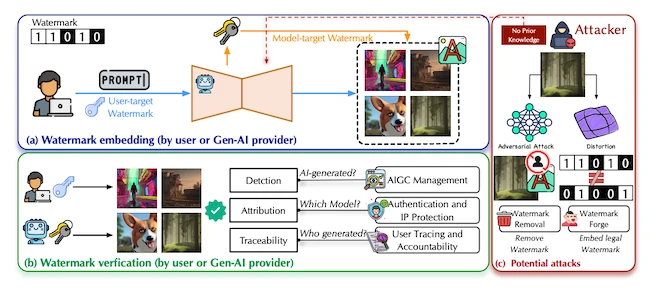

生成式人工智能(GenAI)简化了图像创作过程,但也带来了知识产权、真实性和责任认定等方面的难题。加拿大女王大学的研究人员探讨了通过水印技术标记AI生成的图像,以便验证其来源和完整性。

水印技术概览

构建框架

水印系统作为一个完整的安全流程,包括嵌入、验证、攻击渠道和检测等多个关键环节。这一过程始于将编码信息植入图像,无论是在生成过程中还是之后。这些信号随后可以被提取并与密钥匹配,以确认图像的来源。

有些水印在图像完成后添加,而有些则在生成过程中嵌入。当水印内置于模型本身时,它成为图像创建过程的一部分,更有可能在压缩、裁剪或其他小改动后仍能保留下来,而这些操作通常会破坏外部标记。

每个系统都依赖于加密密钥、嵌入程序和统计检验。水印必须对观看者不可见,但对授权用户可读。它应能在常规图像处理中保持完整,同时足够私密,以防止他人复制。

调查指出,将水印视为一种定义明确的安全流程,可以像加密或认证系统那样对其进行测试和改进。这种结构为研究人员提供了一种通用的语言来衡量可靠性和可追溯性。

主要技术对比

水印技术最初采用信号处理方法,通过离散余弦变换或小波分析等技术改变像素值或频率系数。这些技术简单易行,但未能与生成模型创造图像的复杂方式相匹配。

随着深度学习的发展,新的可能性出现了。像HiDDeN、RivaGAN和StegaStamp这样的编码-解码网络学会了自动隐藏和检索标记。训练过程平衡了隐形性和恢复能力,有时还使用对抗学习来抵抗噪声或模糊。

扩散模型如Stable Diffusion和Midjourney带来了另一项转变。研究者开始直接在这些系统中嵌入标记,形成了两种主要方法:微调法和初始噪声法。

微调方法,如Stable Signature和WOUAF,通过对扩散模型的部分进行修改,使得该模型生成的每张图片都携带识别代码。这可以指向模型的创建者或特定用户,从而保护知识产权。然而,这种方法需要重新训练大型模型,消耗大量计算资源。

初始噪声法通过改变扩散模型使用的随机噪声作为起点。由于每张图片都是从这个噪声开始的,因此调整它可以使得水印贯穿整个生成路径。TreeRing、RingID和PRC是这类方法的主要例子。TreeRing在频域中嵌入圆形图案,而PRC使用看起来与自然噪声相同的加密代码。这些方法应用更快,可以携带更多信息,但也引入了新的弱点。

系统测试

研究者主要依据三个标准评估水印技术:视觉质量、容量和可检测性。

视觉质量检查标记是否损害了图片的质量。常用的度量指标包括结构相似性指数(SSIM)和Fréchet Inception距离(FID)。良好的水印应该保持不可见,并且不应改变图像的外观或传达的信息。

容量衡量可以存储的数据量。早期技术只能隐藏少量位,而像PRC这样的方法可以嵌入多达2500位。这允许嵌入识别代码、时间数据或政策标签,但存储的信息越多,标记被发现或篡改的可能性也越大。

可检测性指水印在经历变化或攻击后能否可靠地被恢复。系统必须避免误报和漏报。即使很小的错误率,在扫描大量图像库时也可能造成严重问题。正确设置检测阈值对于防止错误分类至关重要。

暴露弱点

许多水印方案在压力下仍然脆弱。攻击者可以通过裁剪、压缩或将图像通过另一个模型重新生成来移除隐藏模式。还有一些人伪造标记,以声称所有权或赋予虚假可信度。

作者将这些威胁分为两类:鲁棒性和安全性。鲁棒性衡量标记是否能抵御无意的失真,如压缩或随机噪声。安全性涉及有针对性的行为,如伪造或窃取密钥。如果标记可以被复制或重用,其价值就会消失。

新的攻击策略利用了扩散模型的工作原理。再生攻击通过将图像重新输入模型,生成几乎相同的图片而不留下痕迹。检测器感知攻击则通过微小的像素变化来欺骗验证工具,同时保持图片视觉上的不变。这些战术反映了在机器学习安全其他领域所见的对抗技术。

防御措施包括加密水印密钥、改变标记的位置以及训练模型在生成过程中识别并保留水印。这些措施旨在即使攻击者调整方法,也能保持水印的完整性。

全球对带有水印的人工智能内容的兴趣日益增长。中国政府已经要求对人工智能生成的材料进行标记。欧盟的《人工智能法》也包含了提及机器可读标记的透明度规定。

在美国,白宫和国家标准与技术研究院的联邦指导支持自愿使用水印。大型企业也在进行试验。谷歌的SynthID在图像创建过程中嵌入不可见的标记,而OpenAI则推广C2PA框架,以实现跨工具的共享元数据。

(以上内容均由Ai生成)