寒武纪适配DeepSeek-V3.2-Exp,开源大模型推理引擎

快速阅读: 寒武纪成功适配DeepSeek-V3.2-Exp模型并开源vLLM-MLU源代码,提升AI计算效率,降低训练成本,为开发者提供强大支持,推动AI技术发展。

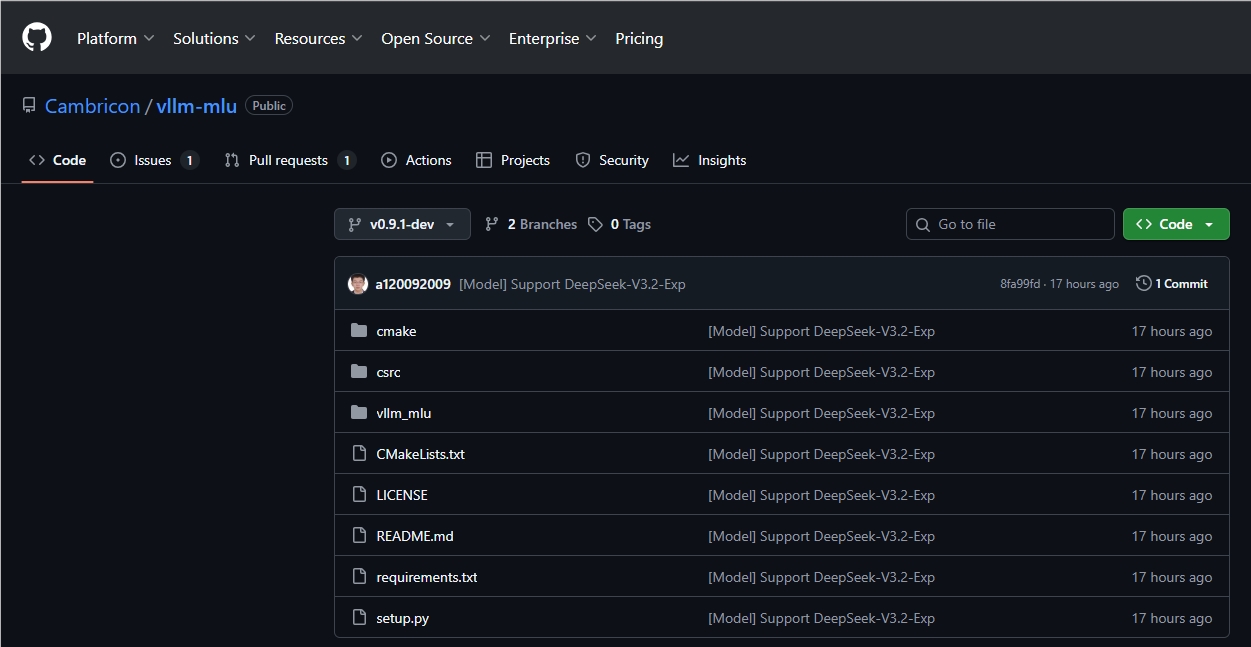

寒武纪宣布成功适配最新发布的 DeepSeek-V3.2-Exp 模型,并开源了大模型推理引擎 vLLM-MLU 的源代码。这一消息为 AI 行业注入了强心针,也令众多期待 AI 技术发展的开发者感到振奋。

DeepSeek-V3.2-Exp 是深度求索公司推出的实验性模型,在功能和效率上进行了创新尝试。寒武纪对此给予了高度关注和支持,认为这是其在大模型软件生态建设上取得的重大进展。凭借深厚的技术积累,寒武纪研发团队迅速完成了对这一新模型的适配,彰显了其在技术创新方面的领导地位。

技术实现方面,寒武纪利用 Triton 算子快速完成适配,并通过 BangC 融合算子优化了性能。这些技术手段不仅提高了计算效率,还减少了处理长序列数据时的训练和推理成本,为企业提升 AI 应用效率提供了经济高效的解决方案。

值得注意的是,DeepSeek-V3.2-Exp 引入了新的 Sparse Attention 机制,显著增强了模型处理复杂任务的能力。寒武纪的技术优势进一步提升了该模型的计算效率,为客户提供了强大的软硬件解决方案。

对于此次合作的成功,寒武纪持乐观态度,期待与 DeepSeek 进行更深入的合作,共同推动 AI 技术的更大突破。同时,开源的 vLLM-MLU 源代码为开发者提供了一个良好的平台,促进了更多技术人员参与这一创新生态系统。

可以说,寒武纪与 DeepSeek 的合作标志着 AI 技术的新飞跃,未来应用场景将更加广泛。随着此次技术升级,AI 将在各行业发挥更大作用,为人们的生活带来更多的便利。项目地址:https://github.com/Cambricon/vllm-mlu

(以上内容均由Ai生成)