苹果发布Manzano图像模型,实现理解生成双突破

快速阅读: 苹果研发的Manzano图像模型,能同时处理图像理解和生成,解决开源模型技术难题,其性能接近商业系统,尤其在文本密集型任务上表现优异。

苹果公司近期在其研究中介绍了一种名为 Manzano 的新型图像模型,该模型旨在同时处理图像理解和生成。这种双重能力的实现是当前许多开源模型面临的技术难题,而苹果表示,这使得 Manzano 在图像处理的效率和效果上更接近商业系统,例如 OpenAI 和谷歌提供的技术。

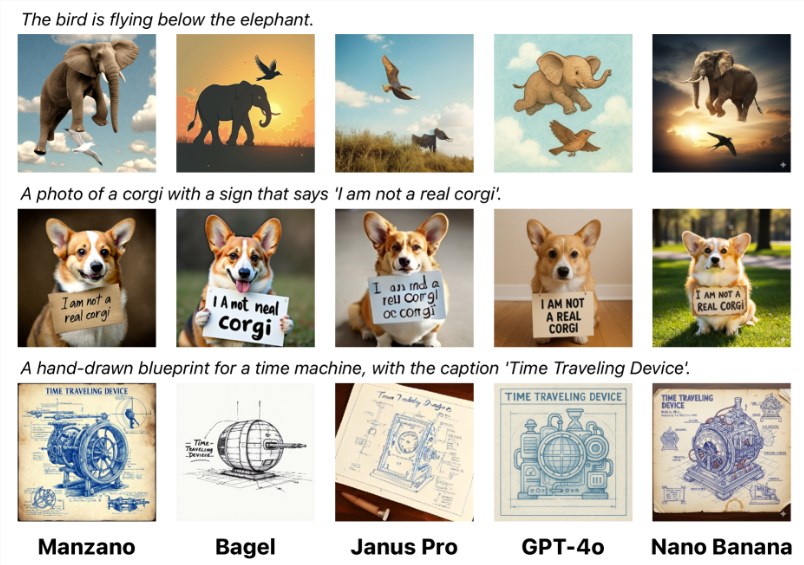

目前,Manzano 尚未对外发布,也未进行公开演示。不过,苹果的研究团队分享了一篇研究论文,并附带了一些低分辨率的图像样本,展示了模型在处理复杂提示时的能力。这些样本与开源模型 Deepseek Janus Pro 和商业系统 GPT-4o、Gemini2.5Flash Image Generation(又称“Nano Banana”)的输出进行了对比。在三组具有挑战性的提示测试中,Manzano 的表现与 OpenAI 的 GPT-4o 和谷歌的 Nano Banana 相当。

苹果指出,目前大多数开源模型的主要限制在于,它们通常需要在强大的图像分析和生成能力之间做出选择,而商业系统则能兼顾两者。特别是在处理包含大量文本的任务时,如阅读文件或解读图表,现有模型的表现尤为不足。

Manzano 的设计采用了混合图像标记器,这一核心理念使其能够输出两种类型的标记:连续标记和离散标记。连续标记通过浮点数表示图像,用于理解,而离散标记则将图像划分为固定的类别,便于生成。由于两种标记均源自同一编码器,这减少了传统模型中可能出现的冲突。

在训练过程中,Manzano 结合了连续和离散适配器来调整语言模型的解码器。推理时,它提供了理解和生成图像所需的两个数据流。Manzano 的架构主要包括三个部分:混合标记器、统一语言模型和用于最终输出的独立图像解码器。苹果构建了三种不同参数量的图像解码器,参数量分别为0.9亿、1.75亿和3.52亿,支持256至2048像素的分辨率。

苹果的测试结果显示,Manzano 在多个基准测试中表现出色,尤其在处理文本密集型任务如图表和文件分析方面,30亿参数版本的得分尤为突出。研究还发现,随着模型参数量从3亿增至30亿,性能持续提升。

Manzano 不仅能处理传统的图像编辑任务,还能执行基于提示的编辑、风格迁移、图像填充、扩展和深度估计等新任务。苹果认为,Manzano 是现有模型的一个可行替代方案,其模块化设计可能对未来多模态 AI 产生深远影响。

论文链接:https://arxiv.org/abs/2509.16197

划重点:

🌟 Manzano 是一种新型图像模型,能够同时进行图像理解和生成。

🔍 苹果的研究表明,Manzano 在处理复杂文本任务时表现出色,接近商业系统的水平。

⚙️ 该模型采用混合图像标记器,减少了图像理解与生成之间的冲突。

(以上内容均由Ai生成)