AI代理炒作背后:企业投资回报率低,信任度下降

快速阅读: 人工智能代理虽受追捧,但实际效能存疑。高德纳预测2027年40%的AI代理将被淘汰,企业需警惕盲目跟风。目前,AI代理面临信任危机及成本挑战,安全审查日益严格。

人工智能代理已成为科技领域的新宠,为生成式人工智能注入了新的活力,同时也延续了长久以来关于真正智能自动化的承诺。大型科技公司一年多来一直在宣称,人工智能代理能够以前所未有的程度实现这一承诺,通过详细用户指令自动完成任务。微软预测到2028年将有13亿个AI代理投入运行,描绘了一个庞大且相互关联的世界,在这个世界里,代理们能够协作完成任务。

然而,这并不意味着什么。对于所有IT决策者而言,这些代理中有数十亿可能只能执行最简单的任务,对生产率的提升微乎其微。仅仅在企业环境中增加更多的代理,并不能保证是件好事,就像单纯增加员工数量如果他们不擅长工作也毫无意义一样。

目前,AI代理在“工作”上仍表现不佳,尤其是在投资回报方面。高德纳预计到2027年将有40%的AI代理被淘汰,并警告不要采用实际上只是重新包装的RPA和聊天机器人工具。实际操作这些工具可能会让人感到困惑,而从外围撰写相关报道更是令人头疼。

生成式AI的发展模式已经十分明显:开发者在大肆宣传下推出新的架构或框架,随之而来的是对这些工具如何彻底改变工作场所的大胆断言,然后企业在接下来的两年里试图从这些产品中榨取价值。最终结果总是相同的,即失望的IT团队和被最新AI热潮吸引而感到困惑的高管们。

这并不是说企业不会找到利用AI获益的方法。我只是想说,如果你真的相信让自主AI代理在企业中自由运作就能自动促进增长和提高生产率,那么你可能会迎来一个不愉快的惊喜。AI代理不仅受到赞誉,也面临着来自安全领域的严格审查。对AI代理的信任度可能实际上正在下降,安全专家公开呼吁更多地讨论AI代理的风险。

一些公司担心AI代理失控造成损害,开始使用AI代理监督其他AI代理。这并非小众现象,高德纳预测到2030年,这些“守护者代理”将占代理AI市场的10%至15%。我们究竟在做什么?在我看来,公司被鼓励进入一个“谁来监视监视者”的困境,这对他们的利润没有实际好处。AI代理要么可信,要么不可信——再多的监督也无法改变这一点。

当然,向企业推销AI代理的公司非常乐意将其作为解决自身问题的方案。全天候工作的“员工”这一承诺是一把双刃剑,因为当要求这些模型24/7处理信息时,推理云AI模型的成本会不断累积。

最初的AI代理开发人员曾保证,这些工具将始终有人类监督,以防止基于幻觉的重大错误发生,并保护AI开发者免受这些潜在灾难性错误的影响,特别是在部署代码时。然而,这也否定了代理的主要卖点,即它们可以自主工作,无需持续的人类监督。

于是,推理技术应运而生。开发人员将其视为LLM的下一个重大进步,因为它允许逐步分解用户需求,提供更详细、更实用的答案和回应。它还被认为是AI代理的重要推动者,因为它使代理能够更加自主地行动,适应变化的条件或输入环境,从而在用户指令之间保持更长时间的独立运行。

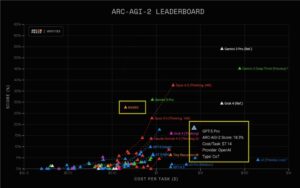

推理模型可以生成“思维链”,即模型做出每个决定的分解,以便用户评估模型的推理过程并追踪其决策的原因。问题是,推理并不总能奏效。今年早些时候,苹果的一项研究得出结论,推理模型可能会简单放弃。

面对足够复杂的问题时,即使仍有资源可以继续工作,也难以应对。

在科技媒体行业工作,很容易被常规的产品发布所吸引。我之前曾提到,我们所有人都应该少关注个别模型的发布,而更多地关注它们实际支持的应用场景。

然而,跟踪LMArena排行榜以及OpenAI、Google和Anthropic等公司的最新进展依然具有强烈的吸引力。自6月苹果论文发布以来,我们见证了一系列重要的人工智能发布——即便是备受期待但表现平平的GPT-5——这些都吸引了我们的注意力,让生成式人工智能保持了热度。

然而,对于苹果的这篇论文,至今没有出现重要的回应。只有当我看到实际成果时,才会相信人工智能代理的潜力。

(以上内容均由Ai生成)