微软开源VibeVoice-1.5B模型,实现90分钟超长语音合成

快速阅读: 微软研究院开源VibeVoice-1.5B音频模型,实现90分钟超长语音合成,支持四位发言人,3200倍音频压缩,采用双tokenizer架构,提高合成质量和效率。

近日,微软研究院正式开源最新音频模型——VibeVoice-1.5B。该模型在语音合成技术上实现了多项重大突破,使合成的语音更加自然、时长更长、效果更优。

VibeVoice-1.5B 能够一次性合成90分钟的超长语音,这在以往的语音合成模型中较为罕见。此前,大多数模型只能合成60分钟以内的语音,并且在超过30分钟时容易出现音色漂移和语义断裂的问题。此外,该模型还支持最多四位发言人,显著提高了多说话人的合成效果,而以往的开源模型最多只能支持两位发言者。VibeVoice 还实现了对24kHz原始音频的3200倍压缩,大幅提高了压缩效率,同时保留了高保真的语音效果。

VibeVoice 模型的核心在于其独特的双tokenizer架构。与传统TTS模型多依赖单一tokenizer提取特征不同,VibeVoice创新性地引入了声学tokenizer与语义tokenizer的协同工作机制,解决了音色与语义不匹配的问题。声学tokenizer专注于保留声音特征并实现极致压缩,而语义tokenizer则负责提取与文本语义相一致的特征,确保合成语音的情感与文本内容一致。

在训练方面,VibeVoice采用了课程学习策略,逐步增加输入序列长度,避免了因处理超长序列而导致的训练失败。训练过程中,声学tokenizer与语义tokenizer的参数保持不变,确保了特征提取模块的稳定性,从而缩短了训练周期。

VibeVoice-1.5B的开源不仅为语音合成领域带来了新的技术突破,也为未来更大参数模型的发布奠定了基础。对于音频处理和语音合成的研究人员和开发者来说,这是一个值得关注的创新进展。

开源地址:https://huggingface.co/microsoft/VibeVoice-1.5B

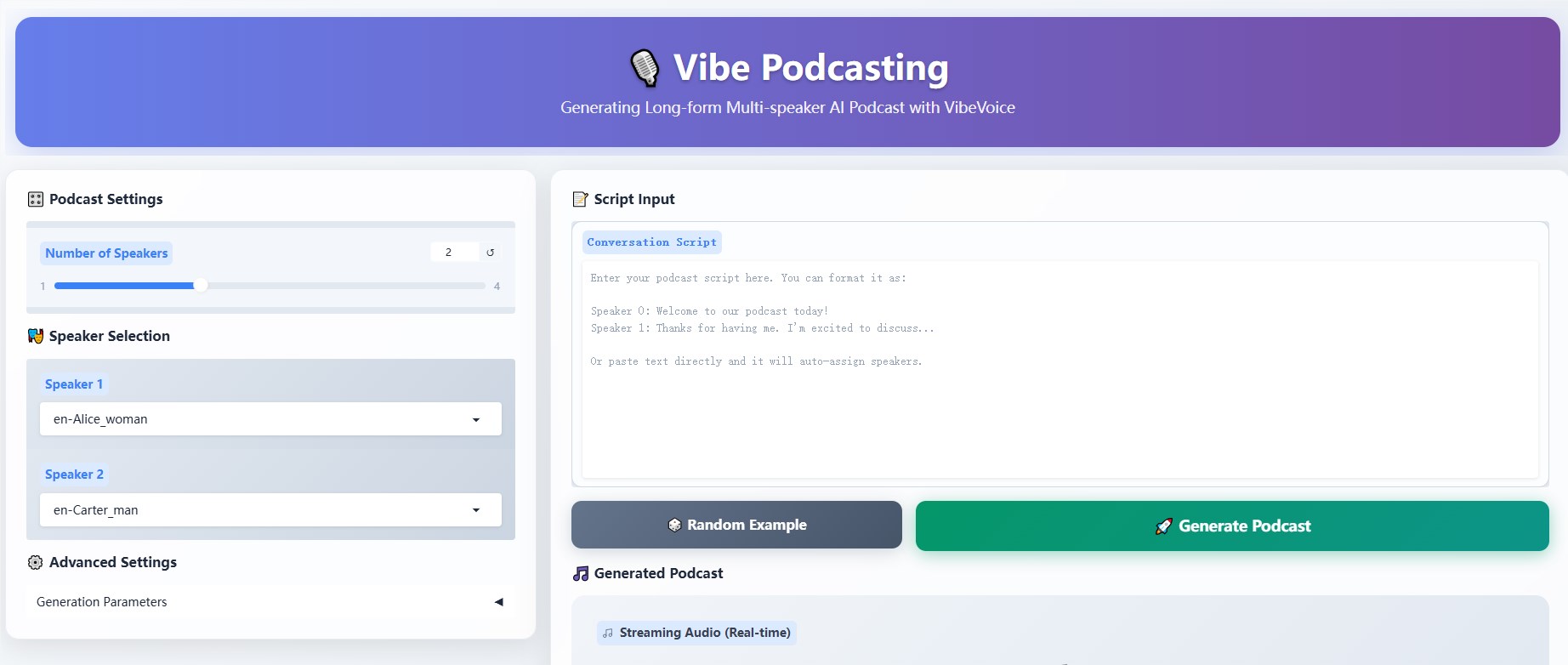

在线演示:https://aka.ms/VibeVoice-Demo

要点:

– VibeVoice-1.5B 模型可一次性合成90分钟的超长语音,支持最多四位发言人。

– 该模型实现3200倍的音频压缩率,保持高保真的语音效果。

– 采用双tokenizer架构,解决音色与语义不匹配的问题。

(以上内容均由Ai生成)