英伟达发布新款小型模型Nemotron-Nano-9B-V2,免费商用性能优越

快速阅读: 英伟达发布Nemotron-Nano-9B-V2小型语言模型,参数量90亿,专为A10 GPU优化,支持九种语言,处理速度快6倍,内置“推理”功能,开放企业友好许可,无需支付费用或版税。

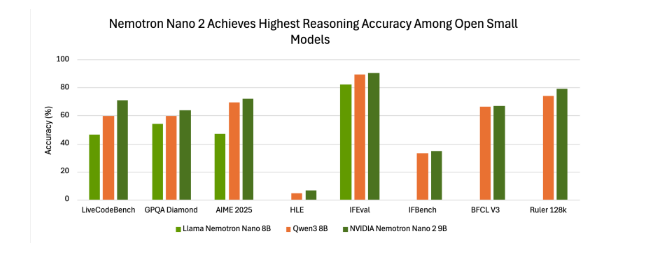

英伟达发布最新小型语言模型 Nemotron-Nano-9B-V2,在多个基准测试中表现出色,并在特定测试中达到同类产品最高水平。麻省理工学院和谷歌此前也推出了可在智能手表和智能手机上运行的小型 AI 模型。

Nemotron-Nano-9B-V2 参数量为 90 亿,比一些数百万参数的微型模型要大,但比之前的 120 亿参数版本显著减小,并专门针对单个英伟达 A10 GPU 进行优化。英伟达 AI 模型后训练总监 Oleksii Kuchiaev 表示,这种调整是为了适配 A10 这款热门的部署 GPU。此外,Nemotron-Nano-9B-V2 是一款混合模型,能处理更大的批次,速度比同等规模的 Transformer 模型快 6 倍。

该模型支持多达九种语言,包括中、英、德、法、日、韩等,并擅长处理指令跟踪和代码生成任务。其预训练数据集和模型本身已在 Hugging Face 和英伟达的模型目录中提供。

Nemotron-Nano-9B-V2 基于 Nemotron-H 系列,该系列融合了 Mamba 和 Transformer 架构。传统的 Transformer 模型虽然强大,但在处理长序列时会消耗大量内存和计算资源。Mamba 架构引入了选择性状态空间模型 (SSM),能够以线性复杂度处理长信息序列,从而在内存和计算开销上更具优势。Nemotron-H 系列通过用线性状态空间层替换大部分注意力层,在长上下文处理上实现了 2-3 倍的吞吐量提升,同时保持了高精度。

这款模型的一大创新是其内置的“推理”功能,允许用户在模型输出最终答案前进行自我检查。用户可以通过简单的控制符(如 /think 或 /no_think)来开启或关闭此功能。模型还支持运行时“思考预算”管理,开发者可以限制用于内部推理的令牌数量,从而在准确性和延迟之间取得平衡。这对于客户支持或自主代理等对响应速度有要求的应用场景尤为关键。

英伟达根据其开放模型许可协议发布了 Nemotron-Nano-9B-V2,该协议对企业友好且高度宽松。英伟达明确表示,企业可以自由地将该模型用于商业用途,且无需为使用该模型支付费用或版税。尽管如此,协议仍有一些核心要求,例如用户必须遵守内置的安全机制、在重新分发模型时进行归属标注,并遵守相关法律法规。英伟达表示,该协议旨在确保负责任和合乎道德的使用,而不是通过限制商业规模来盈利。这使得 Nemotron-Nano-9B-V2 成为了那些希望在降低成本和延迟的同时,保持高精度的企业开发者的理想选择。

(以上内容均由Ai生成)