通过可解释的 AI 区分语音障碍

快速阅读: 《Nature.com》消息,研究利用迁移学习技术,通过微调的OpenL3模型对嗓音信号分类,实现疾病预测,准确率达99.44%。XDSS系统助力理解分类过程的时空特征,为嗓音障碍提供可解释诊断,推动早期检测与精准治疗,优化嗓音健康管理。

嗓音可能受到多种病理因素的影响,嗓音病学检查是一种基于声学分析的技术,用于评估从嗓音信号中提取的特征参数。计算机辅助决策系统能够帮助专家仅通过嗓音检测便识别嗓音疾病。嗓音病学检查主要依赖于声学分析,以评估从嗓音信号中提取的特征参数。

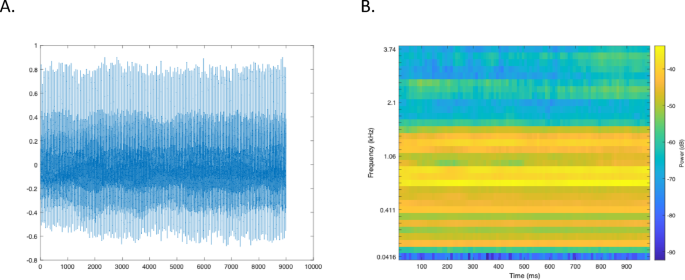

本研究采用了迁移学习技术进行声学分析。经过微调的OpenL3模型,通过将信号分为八类不同的疾病,实现了对信号是否包含病理的预测,具体方式是通过对信号进行分类完成的。研究使用了一个公开可用的数据集,类别包括过度运动性构音障碍、运动减少性构音障碍、反流性喉炎、声带结节、声带脱垂、声门闭合不全、声带麻痹以及健康类别。实验结果非常令人满意,使用迁移学习的OpenL3模型准确率达到了99.44%。此外,可解释决策支持系统(XDSS)提供了对决策过程的深入理解。获取所有遮挡敏感图的平均图像,有助于我们理解用于分类的嗓音障碍的时空特征。借助可解释性方法,可以探讨一种新概念——可微性,以解释深度网络的黑箱操作。

为了实现快速诊断与预防,这项工作可以通过提供有前景的可解释诊断,为嗓音障碍提供更多细节,从而更好地服务于患者和医生。

这项研究不仅在技术上取得了显著进展,还为嗓音疾病的早期检测和精准治疗提供了重要参考,未来有望进一步优化嗓音健康的管理方案。

(以上内容均由Ai生成)