BBC 的研究揭示了 AI 生成的新闻不准确的规模是“关键检查点”,但我们不应该忽视这项技术

快速阅读: 《新闻公报》消息,BBC研究表明AI生成新闻存重大问题,半数答案有误,凸显技术局限与潜在风险。专家呼吁谨慎采用,强调人机协作与监管的重要性,提出“AI三明治”模式以平衡效率与信任。未来需透明、渐进发展,确保AI在新闻领域应用的可靠性与准确性。

**人工智能新闻生成的挑战与未来之路**

英国广播公司(BBC)近期对人工智能生成新闻摘要的研究提醒我们,生成式人工智能既充满潜力,也存在深刻局限。

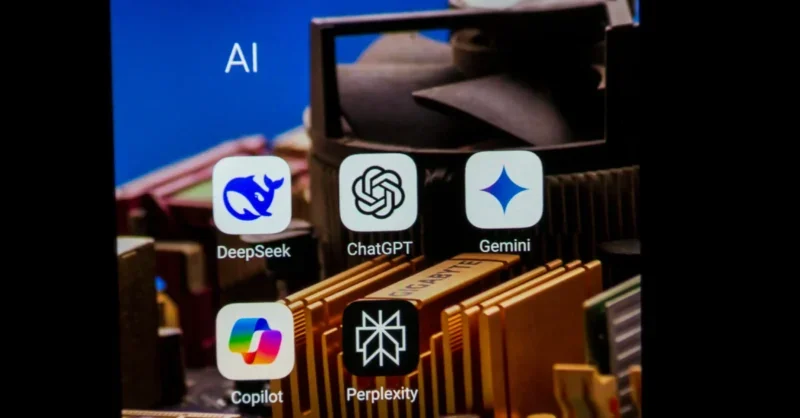

虽然人工智能被视为媒体发展的必经之路,但这项试验揭示了一条令人不安的事实:以目前的形式,人工智能无法可靠地处理和呈现准确的新闻。BBC新闻暂时向四款著名AI助手——OpenAI的ChatGPT、微软的Copilot、谷歌的Gemini和Perplexity开放了其文章,以评估它们处理和准确总结新闻文章的能力。结果显示,当资深记者和编辑审阅这些输出结果时,超过一半(51%)的人工智能生成答案存在重大问题。

近五分之一引用BBC内容的回答引入了事实错误,包括错误的日期、数字和事件。更糟糕的是,13%的引用内容要么被篡改,要么与BBC原内容不符。这无疑质疑了人工智能在无人类监督下传递信息的能力。

真相正在成为牺牲品,而错误信息已成为我们信息消费中的常见现象。

这些发现的意义远远超出了人工智能的技术缺陷。我们已经生活在一个充满扭曲信息的环境中,“真相”不再是固定点,而是竞争叙事的光谱。“我的真相”的兴起,即对事件的主观解读模糊了事实与观点之间的界限,导致公众对媒体的信任度下降。

真相正在成为牺牲品,而错误信息已成为我们信息消费中的常见现象。

现在,如果任由人工智能完全不受纠正,它有可能在已混乱的生态系统中注入另一层扭曲,产生加剧错误信息并进一步侵蚀可靠信息源信任的错误。

我们行业中一个担忧是,人工智能助手常将错误归咎于权威来源。这种心理影响是深远的:当观众看到从可信出版商引用的错误信息时,他们不太可能质疑其真实性。

现在,如果任由人工智能完全不受纠正,它有可能在已混乱的生态系统中注入另一层扭曲,产生加剧错误信息并进一步侵蚀可靠信息源信任的错误。

这不仅误导读者且损害合法新闻报道的公信力,还削弱了合法新闻报道几十年积累的可信度。危险不仅是错误信息,还有对旨在对抗它的机构的信任侵蚀。

如果人工智能生成的不准确信息成为我们信息消费中的常见现象,接下来会发生什么?很可能的结果是公众的进一步疏离感。如果消费者感到他们无法再信任任何来源,他们可能会完全脱离新闻。

这不仅会削弱民主,因为知情公民不可或缺,还会为更大的操纵打开大门。如果真相变得难以辨别,那么叙事将主导公共话语,而不是事实。

对人工智能采用持谨慎态度

然而,这项研究不应被视为对人工智能在新闻和信息传播中的角色的全面谴责。相反,它是一个至关重要的检查点。提醒我们要谨慎而非恐惧地采用人工智能。人工智能潜力巨大,能提升效率、增强可及性,并在媒体及其他领域提供创新方案。

对人工智能采用持谨慎态度

关键不是盲目实施,而是要采取有节制的步骤。我们不应该简单地将人工智能视为一种有缺陷的工具。我们应该试水、评估情况,并决定环境是“红灯”还是“绿灯”。

对人工智能采用持谨慎态度

如果人工智能今天还不成熟,那并不意味着它将来不会成熟。持续关注和评估人工智能将确保其负责任发展并更好地融入信息生态。

对人工智能采用持谨慎态度

需要改变什么?

人工智能公司、出版商、监管机构和公众都扮演着角色

仅仅用数据点喂养大型语言模型并不能解决其当前进入新闻编辑室的障碍。报告清楚表明,人工智能公司需与出版商协作以提升准确性;监管机构需要介入以确保问责制。

人工智能公司、出版商、监管机构和公众都扮演着角色

同时,公众必须提升AI素养,以批判性地评估人工智能生成的信息。作为行业,我们必须透明并坦率地使用人工智能在生产过程中的应用,以提高这种素养,同时也让消费者能够评估和吸收传达的信息。

人工智能公司、出版商、监管机构和公众都扮演着角色

我们也必须超越人工智能生成新闻的新鲜感,认识到其根本的伦理和社会影响。这不是单纯处理一种不成熟的科技;我们正在面对数字时代真相与信任的深层哲学危机。

如果我们现在不解决这些问题,代价不仅仅是几篇误引BBC文章的问题,而是整个信息生态系统的诚信受损。

与此同时,Immediate公司的同事们,他们处于这一创新的前沿,提倡‘AI三明治’模式。该模式将人工智能置于支持角色,而不是唯一的生成者。

通过遵循这一框架,人工智能作为受指令提示的初步处理工具,在人类编辑精炼、核实并赋予上下文之前进行总结、组织或协助研究。

最后,人工智能还可以在后期处理阶段再次使用,例如进行翻译或格式化改进,然后再次返回供人类审查——在这种情况下称为‘AI夹心三明治’!

这种分层方法确保人工智能效率与人工监督的平衡,创建一个可扩展且值得信赖的系统。‘AI三明治’模式可以为新闻编辑室导航人工智能革命提供一条实用路径。

距离通用人工智能还有很长的路要走

BBC的研究发表在同一周,OpenAI发布了其‘深度研究’模型,当首席执行官Sam Altman在博客中宣布“通用人工智能(AGI)不再是一个遥远的概念,而是开始浮现”,这是一个鲜明的提醒,人工智能距离真正的通用智能还有多远。

它可以模仿人类语言并构造连贯的响应,但人工智能目前仍无法理解细微差别、验证准确性或像训练有素的记者那样行使编辑判断。

当前一代的AI工具令人印象深刻,但它并不智能。而在如此基本的事情上,如真相,接近足够好是远远不够的。

然而,如果人工智能的进化受到仔细监控、测试和优化,就有充分的理由保持乐观。人工智能可以成为一个强大的工具——增强媒体、改善可及性并简化内容消费——但前提是其采用是经过衡量的,并且其弱点得到缓解。

当前一代的AI工具令人印象深刻,但它并不智能。而在如此基本的事情上,如真相,接近足够好是远远不够的。

如果我们采取战略而非鲁莽的方式对待人工智能,它在新闻领域的未来可能是光明的。BBC的研究是一课,而不是丧钟。前进之路在于耐心、审慎与负责任的发展。

(以上内容均由Ai生成)