谷歌宣布“AI 模式”作为使用搜索的新方式,测试今天开始

快速阅读: 据《9to5谷歌》最新报道,谷歌今日宣布并测试“AI模式”,允许用户提出更复杂的问题,由AI生成的回答将占据整个页面。此模式提供更高级的推理和多模态功能,适用于更细致的多部分问题。用户可在搜索结果中点击“AI模式”按钮进入,也可通过上传图片和语音输入查询。AI模式由Gemini 2.0支持,结合实时信息和多个数据源,提供客观和事实性的答案。谷歌计划逐步推广此功能,首先在美国进行测试,并考虑向更多用户提供。

谷歌今天宣布并开始测试搜索的“AI模式”。这一“早期实验”允许用户提出更复杂的问题,这些问题将由占据整个页面的AI生成的回答来解答。根据谷歌的用户测试,人们喜欢AI概览。这导致了更多的查询次数和更长、更独特的查询内容。因为人们发现由于AI,搜索现在可以回答更多类型的问题。为此,公司表示“高级用户”希望对更多类型的搜索获得AI支持的回答。因此,谷歌注意到人们会在查询末尾加上“AI”。这就是为什么谷歌搜索正在增加AI模式,与AI概览相比,它提供了“更高级的推理、思考和多模态功能”。

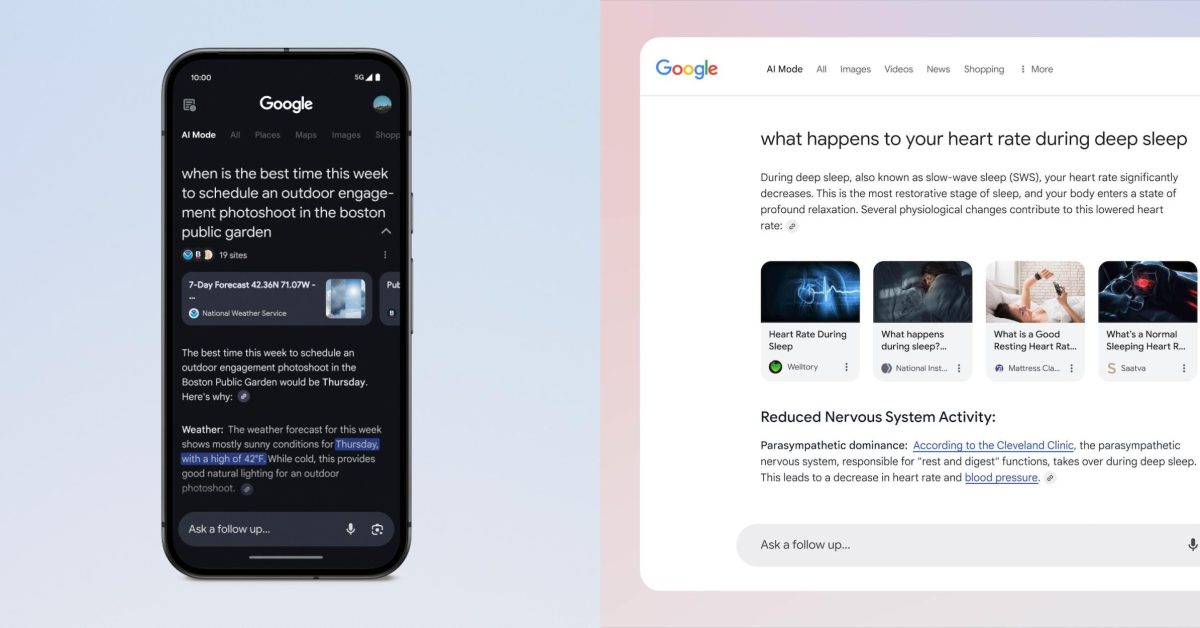

这导致了更多的查询次数和更长、更独特的查询内容。因为人们发现由于AI,搜索现在可以回答更多类型的问题。除了始终得到直接答案外,AI模式还允许你提出以前可能需要多次搜索才能解决的更“细致”的多部分问题。在桌面和移动设备上,你可以像平时一样在谷歌中输入查询,然后点击出现的新“AI模式”按钮,该按钮位于所有、图片、视频等过滤器旁边。AI概览底部还有一个“深入了解”的快捷方式,而专门的入口点让你可以直接进入AI模式,跳过通常的结果,只与新体验互动。你的查询显示在页面顶部,生成的结果出现在下方。不再有顶部搜索栏,你会在底部找到一个聊天式的“追问…”字段。在移动设备上,你可以上传图片并通过语音输入查询给AI模式,但目前只能获得文本输出。线程历史会显示之前的搜索记录。

在下面的例子中,查询是:“迁徙鸟类如何知道去哪里?”从高层次来看,AI模式会思考(或制定计划),执行多个搜索,并整理结果。在移动设备上,在给出简洁答案前,会出现一个展示来源网站的轮播图。然后是一个文章轮播图,之后列出具体方面(在这个例子中)。AI模式由定制版的Gemini 2.0提供支持,具有访问实时源和关于现实世界信息的能力,如知识图谱和数十亿产品的购物图谱细节。谷歌同时进行多个相关搜索并将这些结果结合起来。这种“查询扩散”技术能够跨子话题和多个数据源找到信息并综合处理。模型学习如何验证和支持其所说的内容。如果信息不足,用户会被引导至网页结果。回复旨在是客观和事实性的,不会带有个人色彩或意见。

在第二个例子中,有人问:“本周在波士顿公共花园安排户外拍摄的最佳时间是什么时候?”谷歌根据理想的天气条件(实时信息)回答了一个具体的日期,并推荐了黄金时刻,同时指出了日落的时间。在最后一个例子中,你可以看到AI模式在移动设备和桌面设备上的区别:“智能戒指、智能手表和跟踪垫之间睡眠追踪功能有什么不同?”答案以比较表的形式呈现(今天尚未上线,但很快会上线),你还可以随时追问,比如“深度睡眠时心率会发生什么变化?”

传统意义上没有10个蓝色链接,但你会找到内嵌来源以及桌面端的侧边卡片。未来,谷歌将添加丰富的链接轮播图。谷歌表示,AI模式旨在连接用户与网络,并发现人们本质上希望验证信息并查看各种来源,而不仅仅是AI答案。底层模型经过调校,知道如何链接到来源。从早期测试来看,AI模式查询长度通常是传统搜索的两倍,而且有四分之一的时间会有后续查询。这两种体验旨在共存,谷歌今天在美国更新了AI概览,当提出复杂的编码、高级数学和多模态(如镜头)查询时使用Gemini 2.0。这个列表将会随时间扩展,而所有其他查询则继续使用现有模型。谷歌表示,Gemini 2.0实现了“更快和更高品质”的回复,AI概览将“更频繁地出现在这类查询中”。

同时,谷歌也在全球范围内扩展AI概览,包括无需登录即可使用。从今天起,美国的谷歌One AI高级版(每月19.99美元)订阅者将通过电子邮件受邀选择加入搜索实验室中的AI模式。你也可以在此处加入等待名单。目标是将来能让任何人使用这项体验,但目前的测试主要面向高级用户。

请将9to5Google添加到您的谷歌新闻订阅里。FTC提示:我们使用赚取收入的自动关联链接。更多信息。您正在阅读9to5Google——专家每天报道关于谷歌及其周边生态系统的新闻。务必查看我们的首页获取最新资讯,并关注9to5Google的推特、脸书和领英账号,保持联系。如果您不知道从哪里开始,请查看我们的独家故事、评测、教程,订阅我们的YouTube频道。

(以上内容均由Ai生成)