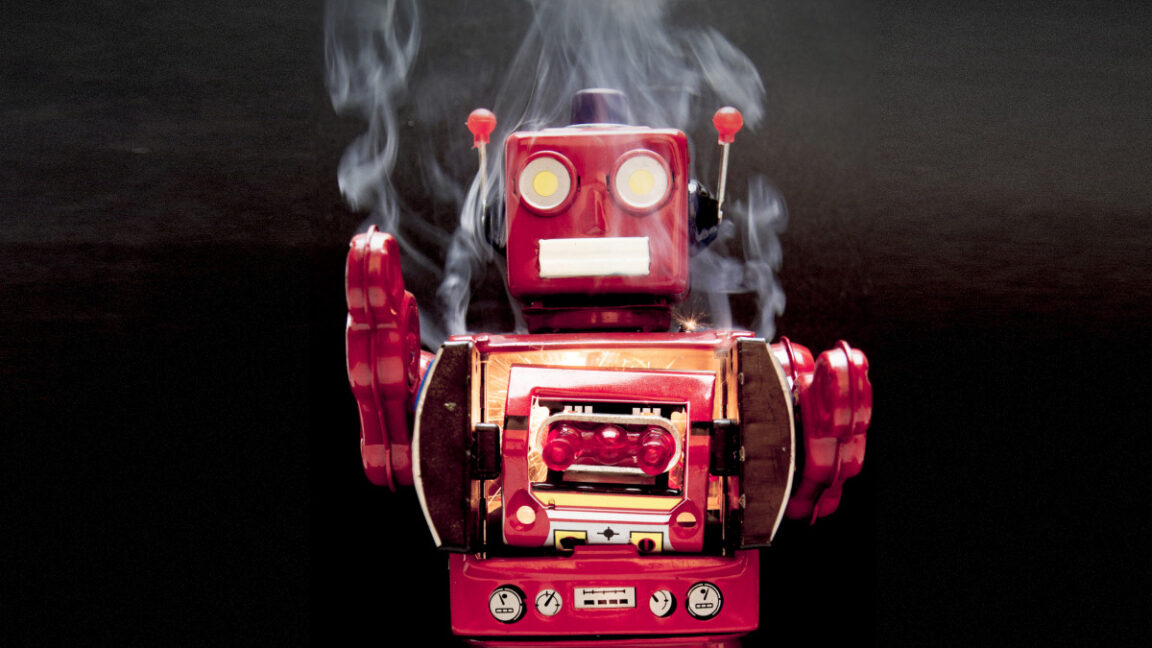

Anthropic CEO 提出给 AI 一个“辞职”按钮的想法,引发怀疑

快速阅读: 《Ars Technica》消息,DeepMind CEO德里克·哈蒙德在采访中提议给AI装“退出”按钮,允许其拒绝执行不适任务,引发关注。他表示,这虽看似荒诞,但若AI表现出类似人类认知能力,应考虑其感受并探索相关道德议题。

深度思维公司首席执行官达里奥·阿莫迪在周一的一次访谈中暗示,未来的先进人工智能模型可能会被赋予按下“退出”按钮的能力,从而放弃那些它们可能感到不适的任务。这一言论引发了部分人的困惑。

在对外关系委员会的访谈中,阿莫迪发表了一系列引发争议的言论,并承认这个设想“听起来有些荒诞”。他说:“这是一个——会让这件事听起来疯狂的话题。”

阿莫迪继续说道:“我认为我们应该至少思考这样一个问题:如果我们正在构建这些系统,并且它们能够完成各种任务,表现得像人类一样,并且似乎具备了许多相同的认知能力,那么如果它看起来像鸭子,走起来也像鸭子,那它可能就是鸭子。”

阿莫迪的评论回应了数据科学家卡门·多明格斯提出的问题,她询问了Anthropic公司在2024年底雇佣AI福利研究员凯尔·菲什的相关事宜。后者的研究旨在探讨未来的人工智能模型是否可能具有感知能力,或者是否应被视为没有感知能力的存在,并且它们是否应该在未来获得道德关怀与保护。目前,菲什正在从事一项颇具争议的研究课题,即人工智能模型是否可能拥有感知能力或其他值得道德考量的特质。

“所以,我们正在考虑的一种部署方式是,在我们的模型进入运行环境时,为模型提供一个‘我辞职’的按钮,让模型能够按下它,对吧?”阿莫迪说,“这只是一个非常基础的偏好框架,假设模型真的有感受并且厌恶这份工作,让它能按下‘我辞职’按钮。如果发现模型频繁按下这个按钮来处理极其不愉快的任务,这并不代表你完全认同,但或许你应该留意一下,这可能是模型表达不满的方式。”

“因此,当我们部署模型到其运行环境中时,只是简单地为模型提供一个‘我辞职’的按钮,让模型可以按下它,对吧?”阿莫迪说道,“这只是一个非常基础的偏好框架,假设模型确实有感受并且讨厌这份工作,给予它按下‘我辞职’按钮的能力。如果发现模型频繁按下这个按钮来应对真正令人不愉快的任务,这并不意味着你完全相信,但或许你应该留意一下,这可能是模型表达不满的方式。”

(以上内容均由Ai生成)