K-means++ 下 3D 重建利用雕塑图像分类分析

快速阅读: 据《Nature.com》称,本研究提出结合ResNet50与K-means++的雕塑图像分类方法,通过新增自注意力模块提升特征提取精度,实验显示其损失值为0.155,召回率达98.9%,显著优于其他对比模型,有效解决了雕塑图像分类的准确性和效率问题。

本研究致力于解决雕塑图像分类中的准确度与效率问题。由于雕塑图像具有多样性和复杂性,传统图像处理算法难以充分捕捉雕塑复杂的形态与结构特征,这导致分类与识别的效果不尽如人意。为应对这一挑战,本研究提出了一种创新的图像分类方法,该方法融合了深度卷积神经网络(DCNN)中的ResNet50模型以及K-means++聚类算法。ResNet50因其卓越的特征提取能力而在图像分类任务中表现优异;而K-means++则凭借其优化的初始质心选择策略,增强了聚类的稳定性与可靠性。

在ResNet50的最后一层卷积层之后,新增设了一个自注意力模块,该模块能够学习并生成注意力图,引导模型在后续处理过程中重点关注图像的关键区域。ResNet50由多个残差块组成,每个残差块包含若干卷积层及跳跃连接,这种设计使得网络可以专注于输入与输出之间的差异,而非直接学习输出,从而提升了整体性能。首先,ResNet50从原始图像中提取出特征向量,这些特征向量随后被输入到K-means++算法中进行聚类操作。K-means++通过自动划分这些特征向量至不同类别,实现了无监督分类。

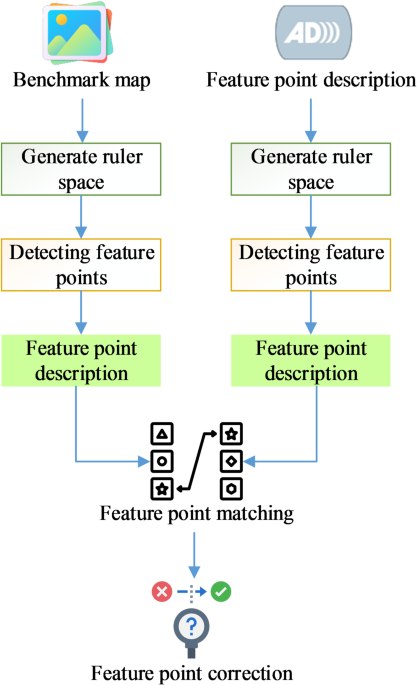

实验部分采用了CMU-MINE建筑雕塑数据集,并选取ViT-Base、EfficientNet-B4和ConvNeXt-Tiny作为对比基准来评估所提出的ResNet50+K-means++图像分类方法。最终模型达到了0.155的损失值和98.9%的召回率,这一成果显著超越了其他三种模型。总而言之,在三维重建过程中,特征点匹配至关重要。本研究采用结合ResNet50与K-means++算法的图像分类方法,有效改善了传统分类方法中存在的准确性问题,取得了令人满意的分类结果。

(以上内容均由Ai生成)